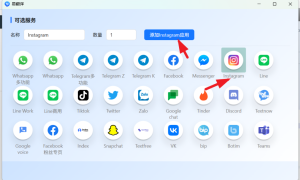

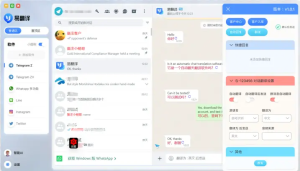

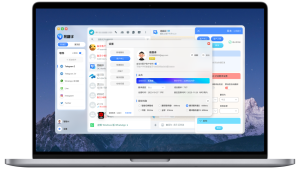

易翻译把听看说写四种输入当成独立又联动的通道:文本走神经机器翻译,语音先经流式语音识别再送译器与语音合成,拍照先做检测与OCR再翻译,双语对话管理上下文与发言者。后端用模型压缩、缓存和术语库提升速度与质量,前端支持离线包和本地隐私保护。用户可自建术语库并选择离线包以保本地数据不出设备的隐私设定灵活。

先把原理拆成小块——像向朋友解释一样

想象一个会说多门语言的助理,他有四只“手”:一只读文字、一只听人说话、一只看照片、一只主持对话。每只手背后其实是不同的技术管线,但它们会互相通气、互相借力。下面我用最直白的方式把这些管线一步步讲清楚,带点比喻,讲到你能看懂内部在做什么,也知道什么时候该怎么使用它才能得到更好结果。

核心四大模块是什么(最概括的视角)

- 文本翻译:输入文本后进入神经机器翻译(NMT)系统,经过分词、编码、解码,输出目标语言。

- 语音实时互译:先把声音变成文字(ASR),再把文字翻译,最后可选把译文合成为语音(TTS)。实时场景会用流式处理以降低延迟。

- 拍照取词翻译:先做图像预处理和文字检测(检测到文字区域),再用OCR识别文字,然后走文本翻译流程。

- 双语对话翻译:管理会话上下文、发言者和回合,把实时识别、翻译、展示结合起来,保持流畅的双向交流。

把每个模块进一步横向拆解(为什么这样设计)

文本翻译管线——像翻译员在做什么

把一段文字交给翻译器,它通常经历这些步骤:语言检测 → 分词/子词化(把句子拆成“可理解的小块”)→ 编码(把词转换成模型能理解的向量)→ 解码(生成目标语言的序列)→ 后处理(恢复大小写、标点、处理专有名词)。现代系统普遍用基于Transformer的神经机器翻译,优点是流畅、上下文敏感,缺点是对低资源领域或专业术语有时认知不足。

语音到语音(实时互译)的关键点

语音流程可以拆成三段:听(ASR)、译(NMT)和说(TTS)。实时场景的难点在于“边听边译”的策略:是等说完一句再翻,还是边听边输出部分翻译?常见策略包括“wait-k”(等k个词后开始翻译)或者增量翻译。

- ASR部分:需要流式识别、端点检测(判断一句话说完了)、噪声抑制和标点恢复。

- 实时翻译:需要处理不完整输入、生成稳定输出,并尽量保留发言者意图与礼貌层次。

- TTS合成:要声音自然、语速合适,还会考虑重音与姓名读法。

拍照取词(OCR)如何配合翻译

手机拍照翻译看似简单,但实际包括:图像增强(去模糊、降噪)、文本检测(定位文字区域)、文字识别(OCR)、布局分析(保持文本顺序)和翻译。印刷体和手写体差别大,竖排、表格或拍摄角度也会影响识别率。

双语对话的工程要点

双语对话不仅是把句子逐句翻译那么简单,还要:

- 区分说话者、保留发言顺序;

- 管理上下文记忆(保留前文信息以翻译代词、引用等);

- 实现场景适配(比如商务、旅游或医疗用语风格不同)。

技术细节:从模型到工程实践(不讲公式,讲概念)

在背后,最常用的就是一类叫做“Transformer”的架构。可以把它想象成一张超级注意力网格:它让模型在翻译时“关注”输入句子的相关部分,而不是只看邻近词。为了在手机上快速响应,还会用模型压缩、量化、知识蒸馏等手段把大模型变“小且快”。服务端通常跑更大的模型以保证质量,客户端跑小模型以支持离线。

常用优化手段是什么

- 模型压缩:把参数变少但尽量保留性能;

- 量化:用低精度数值表示参数以加速推理;

- 蒸馏:用大模型教小模型,提升小模型效果;

- 缓存与本地词典:常用短语、本地术语优先输出,减少网络往返。

系统架构概览(云端与本地的取舍)

一般会有两条路径:云端强模型与本地轻模型。云端优点是能够使用更大、更精细的模型,输出更准确;缺点是要上传数据、依赖网络。手机本地运行的优点是低延迟和隐私,但质量受限。

| 模块 | 常用技术 | 典型延迟/注意点 |

| 文本翻译 | Transformer、子词分割、术语库 | 低延迟(几十到几百毫秒),需处理多义与术语 |

| 语音识别(ASR) | 流式ASR、VAD、声学模型 | 延迟依赖网络与设备,噪声影响大 |

| OCR(拍照) | 文本检测(EAST/CRAFT)、识别(CRNN) | 对光照/角度敏感,表格和手写难度高 |

| TTS | 声码器、波形合成(Tacotron+Vocoder等) | 需要自然发音,合成速度与音色相关 |

举个例子:语音实时翻译是怎么跑的(一步步)

- 设备录音并用噪声抑制处理;

- 流式ASR把音频片段转为中间文本,实时返回部分识别结果;

- 中间文本送到翻译引擎做增量翻译;

- 翻译结果做后处理(术语替换、标点等),然后选择合成或显示;

- 如果网络中断,系统回落到本地模型或显示原文以保证基本可用。

如何提升使用体验——对用户的实用建议

- 短句优先:短句子比长句更易翻译准确,尤其在语音场景下分句清晰更好。

- 提供上下文:遇到专业文档或对话,尽量输入上下文或添加术语表;

- 选择合适模式:旅行模式、商务模式、学术模式有不同优先策略;

- 离线包与隐私:在敏感场景使用离线包可避免上传内容;

- 拍照注意:光线充足、拍正、避免反光与弯曲表面,能大幅提高OCR命中率。

常见失败场景与缓解方法

- 方言或口音强烈:试着靠近麦克风或切换语言变体;

- 专业术语或人名错译:预先添加术语表或手动标注专有名词;

- 低照度或手写内容:采用拍照多角度或手动输入关键片段;

- 并列句或长修饰链:切成更短的句子再翻译。

质量评估与持续改进(系统如何自我提升)

团队会通过自动化指标(如BLEU、chrF)、人工评估与真实用户回放来监控质量。用户纠错、术语表、对话日志(经同意)都会被用来做微调或者增强训练集,从而逐步改善模型表现。这种“人机协同”的闭环是把产品越做越稳的关键。

和学术工作的对接

如果你想更深入理解背后的算法,常见参考包括Transformer原始论文、流式ASR和增量翻译的相关工作、OCR中的文本检测与识别论文等。参考文献名称(可查阅)比如《Attention Is All You Need》、《Listen, Attend and Spell》、《EAST: An Efficient and Accurate Scene Text Detector》。

写到这里,我的脑子里还在顺序梳理那些能直接帮助用户的点儿:遇到问题先判断是识别层(ASR/OCR)的问题还是翻译层(NMT)的问题,再用上面那些小技巧去排查就挺省事的。好,先写到这儿,要是你想针对某一种场景(比如离线旅游、会议同声传译、或者拍照翻译复杂表格)我可以把对应的技术细节和调优建议再细化下。