易翻译把“外语变本地话”当成流水线来做:先听懂或看懂输入(语种识别、ASR、OCR),再把文字切成小块变成机器能懂的“词”,交给训练好的神经翻译模型(常用的是Transformer)去转换,最后再把结果拼回去并做润色和本地化(格式、术语、语气、发音),并通过缓存、在线模型与用户词典不断微调速度与准确率。

先说个比喻,弄明白整体流程

要我用一两句话解释,就像厨房里做一道菜:你先把食材(语音、图片、文字)清洗切好(识别、分词、编码),交给厨师(翻译模型)炒制(编码、注意力机制、解码),最后装盘时放点盐和香菜(后处理、术语替换、格式化),再上桌给客人(用户)尝。

易翻译的“四大核心功能”背后都做了些什么

1. 文本输入翻译:从句子到译文的完整链条

文本看起来简单,但内部步骤不少。下面按“步骤”来拆:

- 语种识别(Language Identification):先判定输入是中文、英语还是其他,避免把中文直接喂给英文模型。常用简单模型或快速特征判断,几乎毫秒级。

- 文本预处理:去掉无用空格、规范标点、处理表情和特殊字符。对中文还要做分词,对英文处理大小写、缩写等。

- 子词编码(如BPE/WordPiece):把词切成子单位,既能处理生僻词,也能减小词表。这一步让模型面对的不是无穷无尽的单词,而是有限的子词集合。

- 神经机器翻译模型(NMT):现代系统通常用Transformer架构。输入被编码成向量,模型通过“注意力”机制学会把源句不同部分与目标句对应起来。

- 解码策略:模型生成译文时会使用贪心、beam search或采样等方法来平衡流畅性和多样性,并可能用长度惩罚、防止重复等技巧。

- 后处理:把子词合并、恢复大小写、校对标点、替换专有名词或术语表里的固定翻译。

2. 语音实时互译:从“说”到“译”的双重挑战

语音实时互译融合了两个子系统:语音识别(ASR)和机器翻译(MT),有时候还要做语音合成(TTS)。核心要点:

- 流式ASR:实时把语音转成文字,边听边输出结果。延迟和准确率之间要取舍,常用端点检测、声学模型与语言模型结合的方式。

- 增量翻译:为了减少响应时间,系统会对ASR的部分输出进行增量翻译,再根据后续语音调整(修正)译文。

- TTS(可选):把译文读出来时,会选择适当音色、语速和停顿,让句子听起来自然。

3. 拍照取词翻译(OCR + MT)

图片里的文字首先靠OCR识别,然后再走文本翻译链路。关键点:

- 版面分析:识别出段落、表格或路牌等不同区域,决定是否需要合并或保留格式。

- 多语言OCR:有些图片同时包含多种语言,系统需要先确定每块文字的语种。

- 后处理与定位:翻译结果要放回图片或以文字形式呈现时要保留原来位置和排版(尤其是在带结构的文本中)。

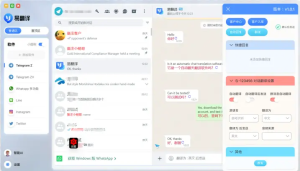

4. 双语对话翻译:把两人对话“同步”成两份流畅的文本

这是最难的场景之一,因为它要求低延迟、句子边界判断和上下文连贯性。

- 说话人分离(Speaker Diarization):区分谁在说话,方便生成针对性译文。

- 上下文维护:保留前后句信息,避免逐句独立翻译导致的错位或歧义。

- 实时纠错:当检测到ASR或MT错误,可以通过用户反馈或后续语句修正之前的译文。

技术细节:把“黑盒”变透明

下面把每个关键环节再拆得更细一些,用一点生活化的解释,方便记忆。

语种识别:先知道你在跟谁讲话

这一步就像服务员先判断顾客讲的是中文还是英语,好决定该拿中文菜单还是英文菜单。它基于字符统计、n-gram、或者轻量级神经网络模型,通常几百毫秒内完成。

分词与子词编码:把长句子切成“词块”

中文没有空格,所以系统要决定哪里是词边界;英文则要处理复合词和罕见词。子词技术(BPE、WordPiece)保证了模型能处理新词,同时把词表规模控制住——想象把长面条切成可煮的小段。

Transformer与注意力机制:翻译的“厨师”在做什么

Transformer的核心是“注意力”。简单说,它在处理一句话时会问每个词:“我应该多关照句子里的哪些其他词来理解你?”这比传统的序列模型更能并行工作、理解长程依赖。训练时用海量双语对照(平行语料)或单语语料+技巧(如迁移学习、预训练)来让模型学会“从A语言到B语言”的映射。

解码与生成:选哪一种译法

当模型“思考”出每个下一个词时,有不同策略:

- 贪心搜索:每步都pick概率最高的词,快但可能不够好。

- Beam search:同时保留若干备选路径,最后挑最优整体句子,常用但费计算。

- 采样和多样化技巧:生成更自然、有创意的表述,适合某些应用。

后处理:把“机器话”修成“人话”

模型输出后还要做格式修复(数字、时间、单位)、专有名词和品牌的固定翻译替换,以及根据目标语言习惯调整语序或礼貌用语。这就是上面比喻里的“放盐和香菜”。

为了快与准,系统做了哪些工程折衷?

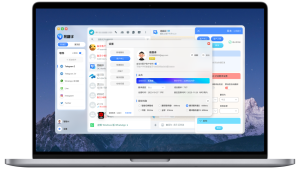

任何实时翻译服务都在三个维度里平衡:速度、准确率、资源消耗。常见的做法包括:

- 在线服务 + 本地缓存:复杂模型放云端跑,本地保存常见短语或用户词典以加速响应。

- 模型蒸馏:把大型模型的知识压缩到小模型里,牺牲少量准确率换更快推断。

- 分层策略:先用轻量级模型做初译,稍后再用重模型做质量提升(background rerank/refresh)。

- 增量处理:语音或长句子边到达边翻,减少感知延迟。

如何保证行业术语和个性化需求被尊重?

翻译工具要贴合用户场景,常用三种手段:

- 术语表/词汇表:允许管理员或用户上传企业术语表,翻译时强制或优先使用固定译法。

- 用户自定义词典:常用名字、地名、品牌名加入本地词典,避免误译。

- 在线学习与反馈闭环:用户改正译文后,系统把这些纠正作为样本用于在线微调或保存在个人偏好。

质量如何评估和持续改进?

传统指标有BLEU、METEOR,近年更多用BERTScore或人工评审来衡量自然度、可懂度和准确性。实际产品还会用A/B测试、用户点击率、纠正率等信号来迭代模型。

| 评估维度 | 常用方法 |

| 准确性 | BLEU、TER、人工打分 |

| 流畅性 | 语言模型困惑度、人工评价 |

| 实用性 | 用户纠正率、任务成功率、参与度 |

隐私与部署方式:云端、边缘还是本地?

不同应用场景有不同选择:

- 云端:能用更大模型、更新快,但数据要上传服务器;适合对实时性要求不极端的场景。

- 本地/边缘部署:在设备上跑小模型,延迟低且隐私好,但模型能力受限。

- 混合方案:敏感数据本地化处理,非敏感或复杂查询走云端。

常见问题:为什么有时候翻得很奇怪?

哦,这个问题很常见。原因大致分三类:

- ASR错误:语音识别把话识错,翻译自然跟着出问题。

- 上下文不足:一句话单独翻译可能产生歧义,长对话中需要上下文记忆。

- 领域外文本:遇到专业术语或新造词,模型可能缺乏训练样本,导致误译。

给用户的实用建议(怎么让翻译更好)

- 尽量把句子说清楚、说完整,口语场景下适当放慢语速。

- 在重要文本中使用术语表或添加注释,尤其是品牌名、专有名词。

- 遇到不确定的翻译,多试几种表达方式,或把长句拆成短句再翻译。

- 利用“反馈/纠正”功能,让系统学习你的偏好。

一些常被忽略但很有用的工程技巧

这里说两点,可能你平时不会注意,但对体验影响很大:

- 延迟掩盖(Latency Hiding):在语音翻译时,先给出部分译文或“正在翻译”的提示,避免用户焦虑。

- 置信度提示:对低置信度的翻译显示提示,让用户知道哪句需要谨慎对待或人工校对。

小结(别真当总结)

你可以把易翻译看作一个由多个小工具组成的流水线:识别、切分、翻译、校正、输出。工程上是各种模型和策略的组合,产品上又要兼顾延迟、隐私和用户体验。说到这儿,可能还有很多具体实现细节会因厂商和版本不同而异,但理解这个“流水线”就足够让你看懂为什么某些场景下翻得好、某些场景下还要人工帮忙。

顺便说句,很多时候我自己用翻译软件也是这样:遇到生僻词、专有名词就直接查词典并把结果复制到用户词典里,慢慢就发现翻译质量稳步提升——挺好玩的。