易翻译靠“本地采集+边缘预处理+云端深度推理”的混合架构联通各项技术:设备采音、拍照或文本输入先做去噪、裁切和分片,边缘负责即时识别与缓存,云端用大规模神经网络做高质量翻译,双方通过安全的HTTPS/WebSocket/gRPC流式接口、消息队列与限流策略实时同步结果,同时用模型蒸馏、差分隐私和本地缓存来兼顾延迟、成本与数据隐私。

先说结论,再慢慢拆解(费曼式思路)

如果你想知道“易翻译技术咋联”,最重要的是记住三点:采集、处理、传输。把它想成做一道菜:先把食材(音频、图片、文本)洗净切好(预处理),厨师(边缘模块)先做些快炒或者把关键步骤处理好,最后把需要大火候的慢炖(云端大模型推理)交给大厨房,过程中通过点菜单(API)、传菜口(消息队列/流式协议)和保鲜柜(缓存、离线包)保证上菜又快又稳。

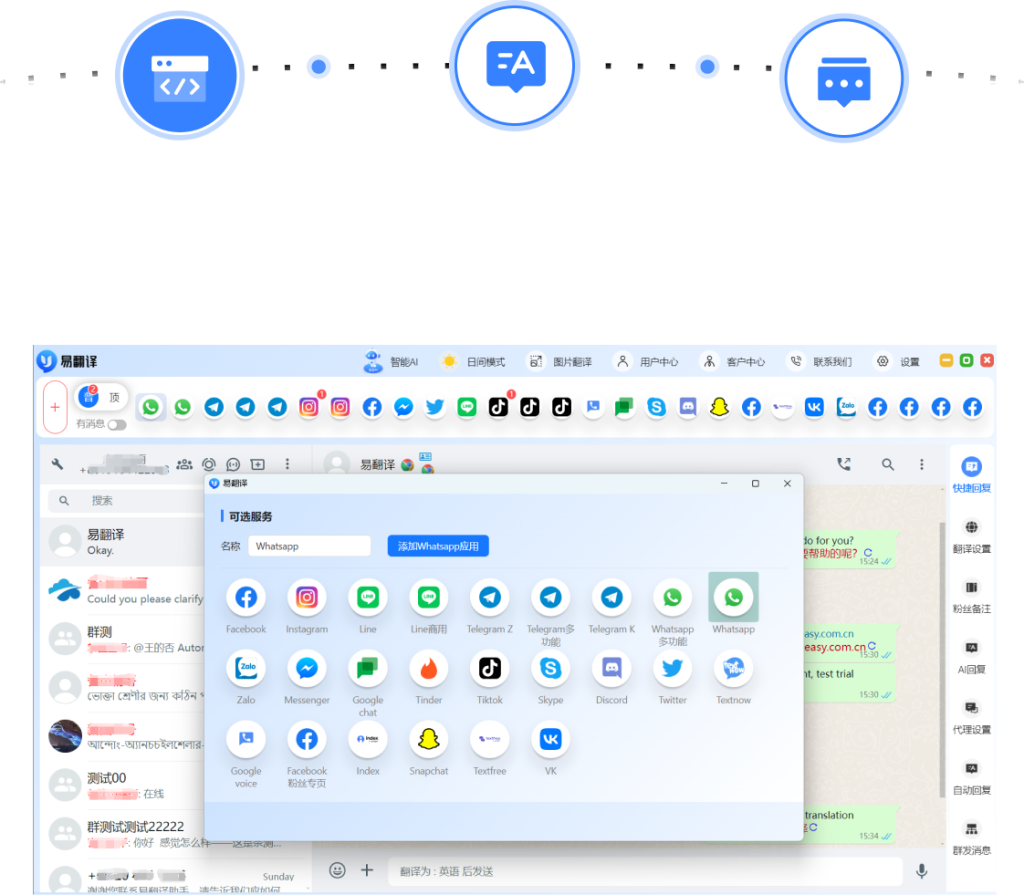

整体架构:从设备到云端的“流水线”

把系统分层看清楚比较好:设备层、边缘/客户端层、云服务层、管理与监控层。这四层互相配合才能把“听得清、看得清、翻得准”变成日常体验。

设备层(手机、耳机、相机)

- 采集:麦克风采样(常用16kHz或16-48kHz),摄像头按需拍照或连续帧。

- 预处理:回声消除(AEC)、噪声抑制(NS)、增益控制(AGC),图像裁剪与透视校正。

- 本地交互:显示翻译结果、缓存短句、简单规则替换(术语表)。

边缘/客户端层(手机端轻模型或边缘服务器)

- 即时任务:语音唤醒、VAD(语音活动检测)、轻量ASR或二次识别、OCR初筛。

- 延迟预算:目标通常 100–300 ms 对话感受,实时对话更苛刻。

- 降级策略:网络差时用本地模型回退或直接播放缓存翻译。

云服务层(高性能推理集群)

- 核心推理:大规模神经机器翻译(Transformer、或大型预训练序列模型),复杂语音识别(Conformer/Transformer-Transducer),高质量TTS(FastSpeech + HiFi-GAN)等。

- 支撑服务:会话管理、用户词典、术语表、并发控制、模型路由(不同精度/成本模型切换)。

- 数据交换:通过HTTPS/REST做短请求,WebSocket或gRPC用于实时流式传输,消息队列(Kafka/RabbitMQ)用于后台流水线与日志。

关键技术点逐个拆:听得见、看得懂、翻得好

语音到文本(ASR)

现在主流做法是用端到端神经网络:CTC、attention-based encoder-decoder,或更近的Transformer/Transducer/Conformer。优点是模型把声学和语言联系起来,错误模式更易控。

- 输入:16kHz、16位 PCM;预处理包括内置噪声抑制、端点检测。

- 输出:分词或子词(BPE、SentencePiece),方便后续翻译模型对接。

- 优化:用语言模型融合(shallow fusion)或自适应解码降低WER(Word Error Rate)。

图像到文本(OCR)

OCR 现在多采用检测+识别两步:EAST 或 CRAFT 检测文字区域,CRNN 或 Transformer 识别文本内容。移动端常做轻量化模型或把图片裁切传云识别。

机器翻译(MT)

核心是Transformer一类模型,实际工程中会配合:

- 子词分割(BPE/SentencePiece)避免未知词;

- 术语表/强制译文(glossary force)保证关键名词一致;

- 后编辑或融合检索式翻译(LoRA/检索增强模型)提升专业领域质量。

语音合成(TTS)

常见流程:文本规范化→序列到序列预测(如FastSpeech)→神经声码器(HiFi-GAN)生成波形。对话类产品会做说话人风格匹配与情感控制。

数据与通信:怎么从设备到云端传输

关键点是实时性和稳定性,通常采用多层协议:

- 控制命令:HTTPS/REST(短请求,如文本翻译、会话初始化)。

- 实时流:WebSocket 或 gRPC(双向流、低开销,常配合 protobuf 序列化)。

- 消息总线:Kafka/RabbitMQ(后台异步处理、日志、审计、离线训练数据落地)。

常见实践

- 音频流先分帧压缩(Opus 编码常见),低带宽下用更低采样率或更小帧长。

- WebRTC 可用于点对点或绕过网络代理的实时语音通道。

- 采用心跳、重连和指数退避机制保证网络不稳时体验可控。

质量保证:怎么评估和持续优化翻译效果

评估分为自动评估和人工评估两条线。自动指标常用 BLEU、chrF、TER、以及更先进的 COMET,而语音部分关注 WER(词错误率)与CER(字符错误率)。

- 线上质量数据:通过 A/B 测试、用户打分、交互日志来收集真实误差案例。

- 闭环改进:把用户纠正、术语表、并行语料回流到训练集,做持续微调(fine-tuning)。

- 层级模型策略:对低延迟场景用蒸馏后的轻量模型,对高质量需求路由到大模型。

隐私与安全:用户数据怎样被保护

翻译工具触及音频、照片、文本这些敏感输入,保护策略通常具备多层:

- 传输层:全部使用 TLS(HTTPS、gRPC over TLS),接口鉴权用 OAuth2 或 JWT,支持密钥轮换。

- 存储层:敏感数据加密静态存储,访问控制最小权限。

- 处理策略:支持本地优先(关键语音/术语本地化处理),支持差分隐私与联邦学习来减少明文上传。

- 合规:按地区法规(例如 GDPR)设定数据保存期限与删除流程。

工程细节:接口、格式与容错

工程上要解决的是格式对接、速率控制与错误恢复。给开发者用的API通常分为几类:

- REST API:短请求,响应式翻译、设置、获取历史。

- Streaming API(WebSocket/gRPC):实时语音与双语对话,支持半句翻译、增量输出。

- Webhook/回调:长任务完成通知、异步批量翻译结果回调。

| 模块 | 职责 |

| 采集层 | 音视频采样、降噪、端点检测、元数据标注 |

| 边缘层 | 实时ASR/OCR、缓存、网络备援、快速翻译回退 |

| 云推理层 | 高精度MT/ASR/TTS、大模型服务、会话管理 |

| 管理层 | 监控、日志、模型部署、A/B测试与数据回流 |

性能与扩展:怎么保证高并发下仍然流畅

实践中会采用分层缓存、模型分级、弹性伸缩与混合精度推理等手段:

- 缓存与短路:常见短句或术语做本地缓存,减少重复请求。

- 模型路由:按请求优先级选择快/慢模型;低成本模型处理普通场景,高精度模型服务票据付费或队列排队处理复杂请求。

- 批处理与流水线:后台训练/评估采用批量处理,推理采用小批量混合并发提升 GPU 利用率。

实用工程技巧和陷阱(说给工程师听)

- 注意子词不一致导致的术语错译:客户端和云端要共用同一套分词器(SentencePiece 模型)。

- 网络波动下,别把全部状态放云端。用本地缓存会显著提升离线体验。

- 带宽受限时优先传语音的语音特征(MFCC或fbank)或压缩后的Opus而不是原始PCM可以节省大量流量。

- 用幂等接口设计和请求 ID 来避免重试导致的重复计费或状态错乱。

- 日志尽量只记录必要的元数据,敏感内容应脱敏或加密存储以免合规风险。

从实验室到产品:上线与运维要点

把模型搬到线上不是终点,A/B、Canary、灰度发布与回滚能力是必需。监控需要覆盖:

- 延迟分位数(P50/P90/P99);

- 错误率和超时率;

- 关键指标:WER、BLEU/COMET、用户满意度;

- 资源利用率:GPU/CPU、内存、带宽。

训练到部署的小流程(举个例子)

- 收集平行语料与专有术语,做清洗与去重。

- 基于Transformer预训练,再做领域微调。

- 蒸馏出轻量模型做边缘部署,同时保留大模型供精度校正。

- 上线灰度,收集用户纠错回流训练集,迭代。

一些容易被忽略的细节

- 说话人分离(diarization)对于双语对话翻译很关键,否则对话上下文会混淆。

- 在线翻译要考虑“增量输出”与“修正输出”的用户感受——过多回撤会很烦。

- 区域化(locale)不只是语言,还有日期、数值、单位、礼貌用语等需要按场景处理。

写到这里我觉得还可以补两句实战建议:第一,初期把架构做成模块化,能够随时替换模型或协议;第二,重视真实用户数据的闭环,那是模型改善速度最快的燃料。呵,看着没那么学术对吧——其实技术就是把复杂的东西拆开,一项一项解决。